RICERCA LOGISTICA

Di Jay Huang, Ph.D, Dien Wang, Ph.D e Weibin Liang, Ph.D

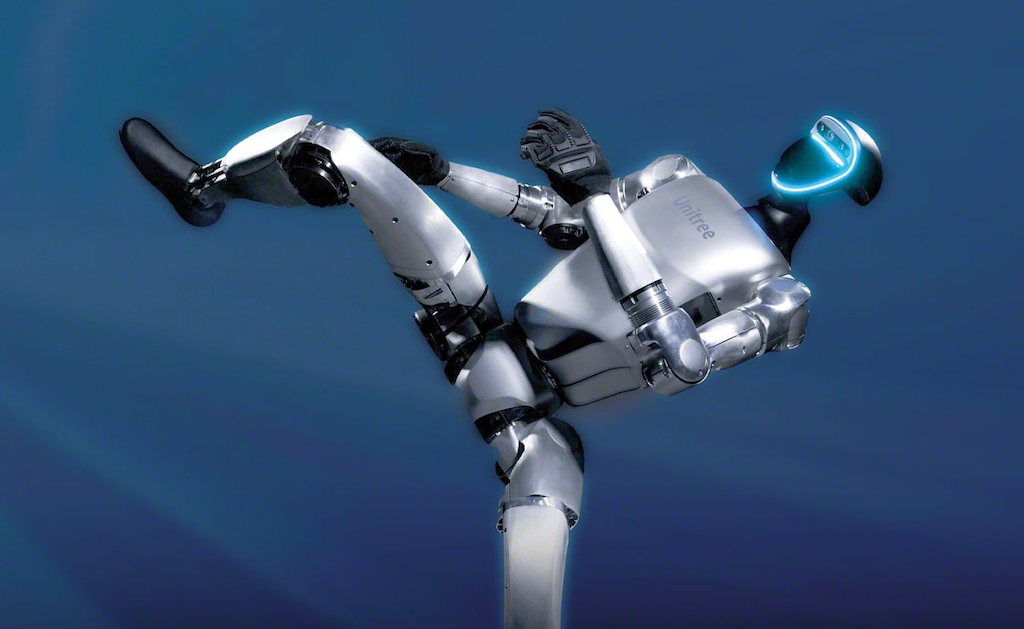

Foto: Unitree

I robot umanoidi, la forma di automa definitiva che l'umanità sognava da tempo, sembrano iniziare a diventare realtà. La presentazione di Optimus ha accresciuto l'interesse del pubblico e dei colossi della tecnologia, nonostante l'industria sia ancora in fase di prototipazione.

Ispirati all'anatomia umana, i tre elementi principali degli umanoidi sono il “cervello”, destinato a pianificare attività e movimenti, il “cervelletto”, che li aiuta a mantenere l'equilibrio e a muoversi agevolmente, e il “corpo”, che fornisce loro la percezione e la capacità di eseguire azioni. Alcune delle principali problematiche che questi robot devono affrontare sono la prevenzione delle cadute e il miglioramento della loro intelligenza per completare diversi compiti.

L'intelligenza artificiale (IA) ha cambiato le regole del gioco. Tecniche emergenti come l'apprendimento per rinforzo, l'apprendimento per imitazione o i Large Language Model (LLM) stanno tracciando un percorso promettente per i robot umanoidi. Grazie al loro "cervelletto", possono mantenere l'equilibrio, evitare interruzioni, eseguire movimenti complessi nei mondi virtuali e poi migrare queste abilità nel mondo reale. I "cervelletti" potenziati con l'IA mostrano notevoli progressi in aree come la stabilità e l'adattabilità dei robot, che in passato rappresentavano enormi complicazioni. E se quest'area del cervello è vitale, il "cervello" degli umanoidi ha una rilevanza ancora maggiore. L'apprendimento per rinforzo e per imitazione è molto promettente nel breve termine per le applicazioni addestrate. L'uso di LLM è interessante, ma nella pratica la loro implementazione rimane una sfida. La teleoperazione, in cui un robot remoto è controllato da un operatore umano, eccelle nella raccolta dei dati di addestramento e può fungere da piano di emergenza se i "cervelli" robotici non sono ben preparati a medio termine.

Prima dell'introduzione dell'IA in questo campo, gli androidi cadevano facilmente

Per quanto riguarda le aziende che sviluppano umanoidi e gli ultimi progressi raggiunti, Unitree è leader nel campo del "corpo" e del "cervelletto". Sebbene inizialmente focalizzata sui robot a quattro zampe, l'azienda è passata al regno dei bipedi e il suo umanoide possiede eccezionali capacità di movimento. D'altra parte, Google DeepMind è all'avanguardia per quanto riguarda il "cervello" robotico. Sta esplorando l'genAI e altre tecniche che vanno oltre i tradizionali LLM, e la sua ricerca si basa su umanoidi semplificati.

I tre elementi cruciali per gli umanoidi sono il "cervello", il "cervelletto" e il "corpo", compresi gli "occhi", le "orecchie", la "pelle", i "muscoli" e le "ossa". Ovviamente, gli aspetti principali da migliorare dei tre sono relativamente indipendenti e possono essere perfezionati in parallelo.

Foto: Unitree

Il “cervelletto”

Come nell'uomo, il "cervelletto" di un umanoide svolge un ruolo fondamentale nella coordinazione delle sue articolazioni garantendo l'equilibrio e l'esecuzione di movimenti fluidi.

Rendere i robot in grado di camminare con stabilità è stata una sfida. Prima dell'introduzione dell'intelligenza artificiale in questo campo, gli androidi cadevano facilmente, quindi era necessario utilizzare cavi di sicurezza per proteggere le macchine più fragili. Sebbene alcune aziende abbiano implementato metodi di controllo relativamente avanzati come il controllo completo del corpo e il controllo predittivo del modello (CPM) con risultati impressionanti, gli umanoidi non sono ancora in grado di difendersi con efficacia in scenari imprevedibili. Hanno bisogno di un'ottimizzazione più efficiente per la loro locomozione o per eseguire attività specifiche, e il "cervelletto" presenta ancora ostacoli in quest'area.

Per fortuna, l'IA, ovvero l'apprendimento per rinforzo, e le potenti tecniche di simulazione disponibili oggi possono cambiare le regole del gioco. L'apprendimento per rinforzo è un processo di tentativi ed errori in cui i robot apprendono comportamenti attraverso interazioni ripetute con il loro ambiente. Gli ingegneri programmano gli umanoidi con ordini su "cosa fare", ma non indicano loro "come farlo" in modo che i robot possano trovare una soluzione in autonomia.

La visione artificiale o 3D tramite scanner LiDAR o telecamere di profondità, mani agili e sensori tattili sono decisivi per le prestazioni degli umanoidi

Per perfezionare questi movimenti, è necessario l'uso di simulazioni, ovvero ambienti virtuali in cui i robot possano migliorare la locomozione e l'esecuzione di attività. Le abilità e le conoscenze acquisite nella simulazione virtuale pueden transferirse a la realidad en infraestructuras conocidas como Sim2Real. Los fracasos son inevitables en las primeras fases, pero finalmente los robots encuentran la manera de superar estas dificultades.

Sebbene il futuro sembri promettente, anche gli ambienti di simulazione e Sim2Real pongono alcuni ostacoli. Sono piattaforme complesse che replicano fenomeni fisici, il che comporta la gestione di aspetti come la dinamica dei corpi rigidi, le collisioni, gli attriti e le deformazioni al fine di creare mondi virtuali il più realistici possibile.

Boston Dynamics ha ridotto la frequenza di caduta del suo robot a quattro zampe a una ogni 50 chilometri. Questa cifra è più alta tra i bipedi, quindi, nonostante abbiano fatto grandi progressi, gli umanoidi hanno ancora bisogno di maggiore stabilità prima di essere diffusamente utilizzati nel settore.

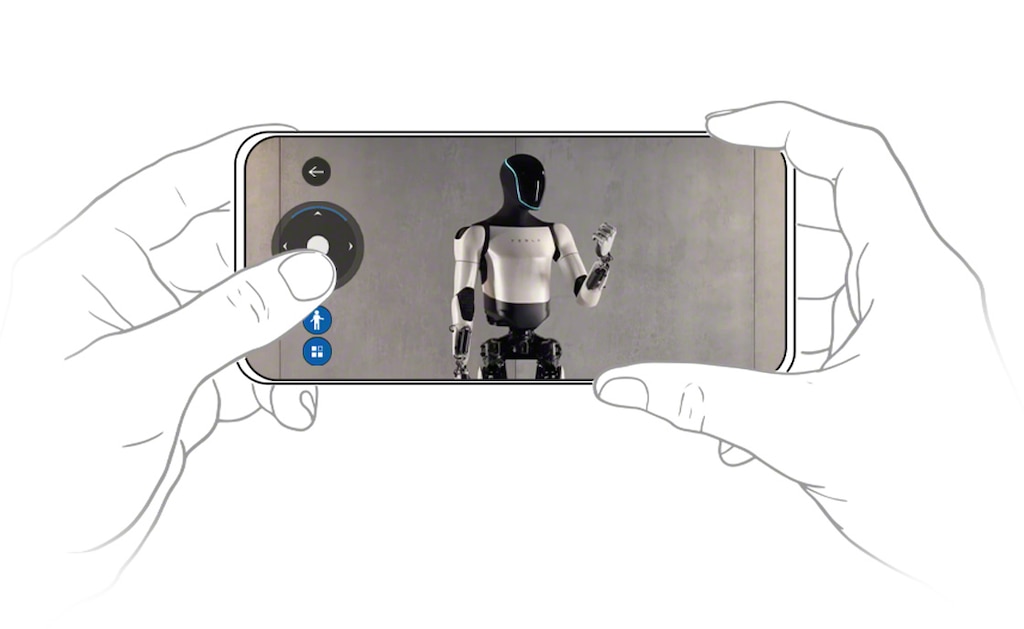

Robot umanoide Optimus Gen-2 di Tesla

Pubblicato con licenza CC BY 3.0 Unported

Il “cervello”

I ricercatori stanno ancora esplorando come rendere i robot sufficientemente intelligenti da eseguire diversi tipi di attività. Nel breve termine, il problema viene affrontato attraverso l'apprendimento per rinforzo e imitazione, mentre nel lungo termine si prevede l'implementazione di Large Language Model e modelli end-to-end.

Oltre a migliorare il movimento dei robot, l'apprendimento per rinforzo è utile per addestrarli a svolgere attività specifiche. Tuttavia, utilizzarlo per raggiungere l'autonomia in azioni più generali può richiedere un'eccessiva quantità di tempo. Ecco perché un approccio più pratico è l'apprendimento per imitazione, in cui una persona mostra all'umanoide come agire attraverso sistemi di teleoperazione.

Il team di Google DeepMind ha proposto di adottare più modelli di grandi dimensioni per gestire le funzioni di percezione, pianificazione ed esecuzione. Per raggiungere questo obiettivo, ha introdotto un modello integrato di visione-linguaggio-azione (VLA) chiamato Robotic Transformer 2 (RT-2) per svolgere queste tre funzioni principali. Ha dimostrato che RT-2 può portare a termine attività che richiedono l'applicazione del ragionamento, della comprensione dei simboli e del riconoscimento specifici dell'uomo. Ad esempio, il comando "metti la fragola nella ciotola giusta" richiede che il robot conosca la differenza tra una scodella e una tazza, ma anche che sia in grado di raggruppare questo frutto con altri simili.

Il “corpo”

Al di là dei componenti principali come motori e riduttori, riteniamo che elementi come la visione artificiale o 3D tramite scanner LiDAR o telecamere di profondità, mani agili e sensori tattili e di pressione siano decisivi per le prestazioni degli umanoidi. Ecco perché crediamo che saranno essenziali per realizzare robot avanzati con funzionalità ottimali.

Tendenze emergenti e problematiche dei robot umanoidi

| Principali moduli dei robot umanoidi | Tendenze tecnologiche | Sfide |

|---|---|---|

| “Cervello” Pianificazione delle attività e dei movimenti |

|

|

| “Cervelletto” Coordinamento delle articolazioni |

|

|

| “Corpo” Percezione dell'ambiente ed esecuzione del movimento |

|

|

Fonti: Accademia cinese delle scienze, Centro di innovazione dei robot umanoidi di Pechino, Università di Tsinghua e analisi di Bernstein.

*Sim2Real, abbreviazione di "simulazione della realtà", si riferisce al trasferimento di movimenti, abilità o conoscenze da una simulazione virtuale al mondo reale.

Implicazioni nel settore

In questa era di "rinascimento dei robot", l'IA spesso integra risorse per le attività di localizzazione, identificazione e ispezione, ma i robot industriali non sono ancora dotati di intelligenza avanzata. Le tecnologie emergenti come l'apprendimento per rinforzo, l'apprendimento per imitazione o i Large Language Model possono rivoluzionare questo settore.

Gli scienziati hanno già dimostrato la fattibilità dell'utilizzo combinato di robot e intelligenza artificiale in aspetti quali l'ottimizzazione delle loro traiettorie e dei tempi di esecuzione, la generazione di strategie per districarsi in scenari complessi e la semplificazione dei processi di programmazione. Con un ecosistema di robot industriali già consolidato, prevediamo che l'intelligenza artificiale ne trainerà l'adozione nel prossimo futuro.

AUTORI DELLA RICERCA:

Jay Huang, Ph.D, Dien Wang, Ph.D y Weibin Liang, Ph.D, analisti di investigazione della Sanford C. Bernstein (Hong Kong) Limited, del Société Générale Groupe.

Pubblicazione originale:

Huang, Jay, Wang, Dien, Liang, Weibin. 2024. “Global Automation: The Humanoid Primer”. Bernstein Société Générale Group.

Questo articolo è stato preparato unicamente all'attenzione di investitori istituzionali e professionali, e non è destinato a investitori retail o privati. Visita www.bernsteinresearch.com per restare informato sugli aggiornamenti.